Hola de nuevo, soy Goslen Burgos. En nuestros viajes anteriores, hemos sido historiadores y cartógrafos, explorando el pasado y el presente de la Inteligencia Artificial. Hoy, nos convertimos en ingenieros y psicólogos. Nos haremos la pregunta que sostiene todo el edificio: ¿cómo es posible que una máquina aprenda?

La respuesta corta está en dos palabras que seguro has oído: Redes Neuronales. Suenan complejas, pero te prometo que la idea central es tan intuitiva como enseñarle a un niño la diferencia entre un perro y un gato.

Olvidemos por un momento los chips y el código, y usemos esa misma analogía.

La Red Neuronal: Un Cerebro en Blanco Lleno de «Diales»

El Punto de Partida: Una Pizarra en Blanco

Imagina que nuestra Red Neuronal es como la mente de un niño muy pequeño. Al principio, es una pizarra en blanco. No sabe qué es un perro ni qué es un gato. Dentro de su «mente» hay millones de pequeñas perillas o «diales», como los de una vieja radio. Cada uno está ajustado al azar. Estos diales son las neuronas (o nodos) de la red, y su configuración determinará la respuesta final.

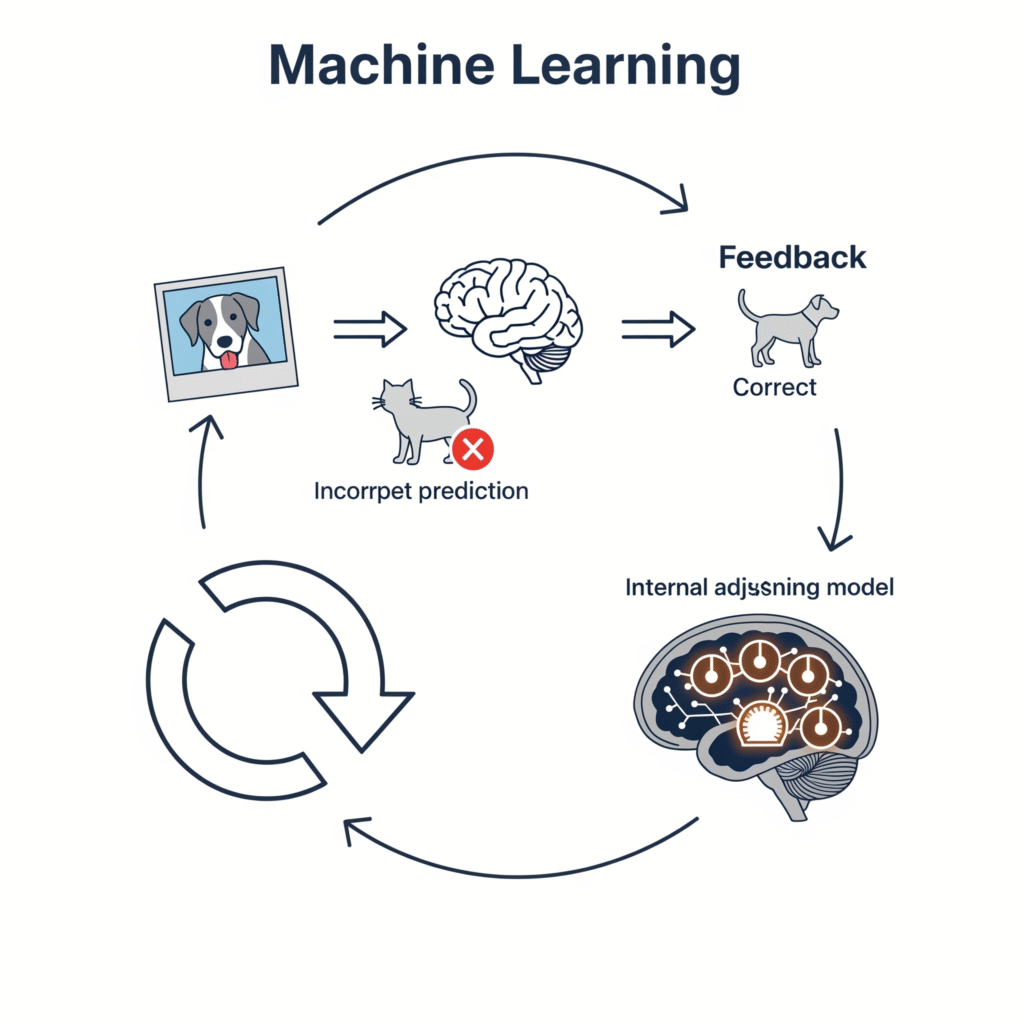

Ahora, comienza el proceso de aprendizaje. Es un baile de cuatro pasos, repetido una y otra vez.

El Proceso de Entrenamiento: Cómo Aprende una IA en 4 Pasos

Paso 1: La Adivinanza Inicial (Predicción)

Le enseñas al niño una foto de un Golden Retriever y le preguntas: «¿Qué es esto?». Como sus diales internos están al azar, su respuesta es una suposición sin fundamento. Señala con el dedo y dice: «¿Gato?«.

Esto es exactamente lo que hace una red neuronal la primera vez. Se le introduce un dato (una imagen, una frase) y, como sus parámetros internos (los diales) no están calibrados, produce una respuesta que es, esencialmente, una conjetura aleatoria.

Paso 2: La Corrección (Cálculo del Error o «Loss Function»)

Aquí viene el momento más importante de todo el proceso. Miras al niño y le dices con una sonrisa: «No, cariño. Eso es un perro«.

En ese instante, no solo le has dado la respuesta correcta, sino que su cerebro registra una información crucial: «Mi suposición fue incorrecta, y ahora sé por cuánto». Este ‘feedback’ es el ingrediente secreto. En el mundo de la IA, a esto se le llama calcular la «función de pérdida» o «error», que no es más que una forma matemática de medir qué tan equivocada estuvo la suposición.

Paso 3: El Ajuste de Diales (Retropropagación o «Backpropagation»)

Este es el verdadero «milagro». Al recibir la corrección, el cerebro del niño hace algo asombroso. No solo memoriza «esto es un perro», sino que reajusta sutilmente las conexiones internas que le llevaron a decir «gato».

Piensa en los diales de su mente. Los que estaban apuntando a características «felinas» (quizás «pequeño», «ágil») se bajan un poquito. Los que apuntaban a características «caninas» (aunque no supiera sus nombres: «hocico largo», «orejas caídas», «sonido de ladrido») se suben un poquito.

Una red neuronal hace exactamente lo mismo en un proceso llamado retropropagación (backpropagation). Utiliza la información del error para viajar hacia atrás por todas sus capas de «neuronas» y ajustar cada uno de los millones de diales, muy ligeramente, en la dirección correcta para que la próxima vez, el error sea un poco menor.

Paso 4: La Práctica Hace al Maestro (Entrenamiento con Datos)

El niño no aprende a distinguir perros y gatos con una sola foto. Aprende viendo cientos, miles de ejemplos. Le muestras un Pastor Alemán, un Caniche, un Siamés, un Persa… cada vez que acierta, sus conexiones se refuerzan. Cada vez que falla, se corrigen.

Este proceso de repetición masiva es lo que llamamos «entrenamiento». Una red neuronal no se «programa», se «entrena». Se le alimenta con una cantidad ingente de datos (imágenes, textos, sonidos) y se repite ese ciclo de «adivinar -> corregir -> ajustar» millones y millones de veces.

El Combustible del Aprendizaje: La Importancia de los Datos

¿Qué Pasa si los Datos de Entrenamiento no son Buenos? El Problema del Sesgo.

La clave de todo esto, el combustible que mueve la sala de máquinas, son los datos. La calidad y la cantidad de los «ejemplos» que le das al niño artificial lo son todo.

- Si solo le muestras fotos de Chihuahuas, se quedará perplejo al ver un San Bernardo. Esto nos enseña sobre el sesgo en los datos: la IA será tan buena (o tan limitada) como los ejemplos con los que aprendió.

- Sin suficientes datos, el aprendizaje es pobre. La revolución de la IA moderna fue posible porque, gracias a internet, de repente tuvimos el «libro de texto» más grande de la historia para entrenar a nuestras máquinas.

Caso Práctico: ¿Cómo se Entrenó a un Modelo como ChatGPT?

Ahora, piensa en ese mismo proceso, pero a una escala que desafía la imaginación.

Imagina que en lugar de un niño, tienes el sistema de computación más potente del mundo. Y en lugar de enseñarle fotos de perros y gatos, le das como libro de texto una parte gigantesca de todo lo que la humanidad ha escrito y publicado en internet: libros, artículos, conversaciones, código…

Al entrenarlo, no le preguntas «¿esto es un perro?». Le das una frase y le pides que adivine la siguiente palabra. Una y otra vez. Billones de veces.

Después de este entrenamiento monumental, sus «diales» internos se han ajustado de una forma tan exquisitamente compleja que ha capturado los patrones, el ritmo, la estructura y las relaciones semánticas del lenguaje humano. No «entiende» la tristeza o la alegría, pero ha visto tantos contextos donde esas palabras aparecen que puede hablar de ellas de una forma que nos resulta coherente.

Conclusión: No es Magia, es un Proceso Elegante

La magia se ha revelado. No es un espíritu en la máquina. Es un proceso de aprendizaje increíblemente simple, potenciado por una cantidad de datos y una velocidad de computación que eran ciencia ficción hace apenas veinte años.

Ahora que hemos visto los engranajes, estamos listos para subir de nuevo y preguntarnos: ¿qué podemos construir con estas máquinas que aprenden? Exploraremos su impacto en la creatividad, la ciencia y nuestro día a día en nuestro próximo encuentro.

Fuentes y Referencias Recomendadas:

- YouTube – 3Blue1Brown: Pero, ¿qué es una red neuronal? | Capítulo 1, Aprendizaje profundo – Una de las mejores explicaciones visuales e intuitivas sobre el funcionamiento matemático de las redes neuronales (el video es técnico, pero el concepto visual es brillante).

- HowStuffWorks: How Neural Networks Work – Un artículo clásico que desglosa el concepto de redes neuronales de una manera muy accesible y paso a paso.

- Google AI: Neural Networks – Una introducción de alto nivel de uno de los pioneros en el desarrollo y uso de estas tecnologías.